DT‑Bot 是一款专为数据处理场景设计的 AI 自动化工具,能够自动完成表格类数据的清洗、转换、统计与计算等任务。它基于流程自动化与智能体协作编排,采用“可视化工作流 + 智能体节点”的创新模式,用户只需通过简单的拖拽操作,即可构建并执行复杂的数据处理流程。

DT‑Bot 主要覆盖 CSV、Excel 等二维结构数据,并支持图片、PDF 等媒体格式,通过 OCR 技术自动提取其中的关键信息。在工作流配置完成后,可对多张表格及多种格式文件进行高效批量处理,支持的数据量级在千万级别以上。

DT‑Bot 专为不具备 Excel、Python、SQL 等数据处理技能的用户打造。借助 AI 技术,用户只需以自然语言描述业务操作步骤,即可轻松完成各类数据处理任务,无需编写任何代码。

使用 DT‑Bot,只需掌握四个核心步骤:

- 数据清洗:对 CSV、Excel 等原始数据进行清洗工作。

- 数据入库:将 清洗后的CSV、Excel 导入平台数据库堆,生成表。

- 表统计:对数据库堆中的表进行统计(过滤,分组,联表,计算等)。

- 数据出库:将表进行下载导出CSV、Excel 结果文件。

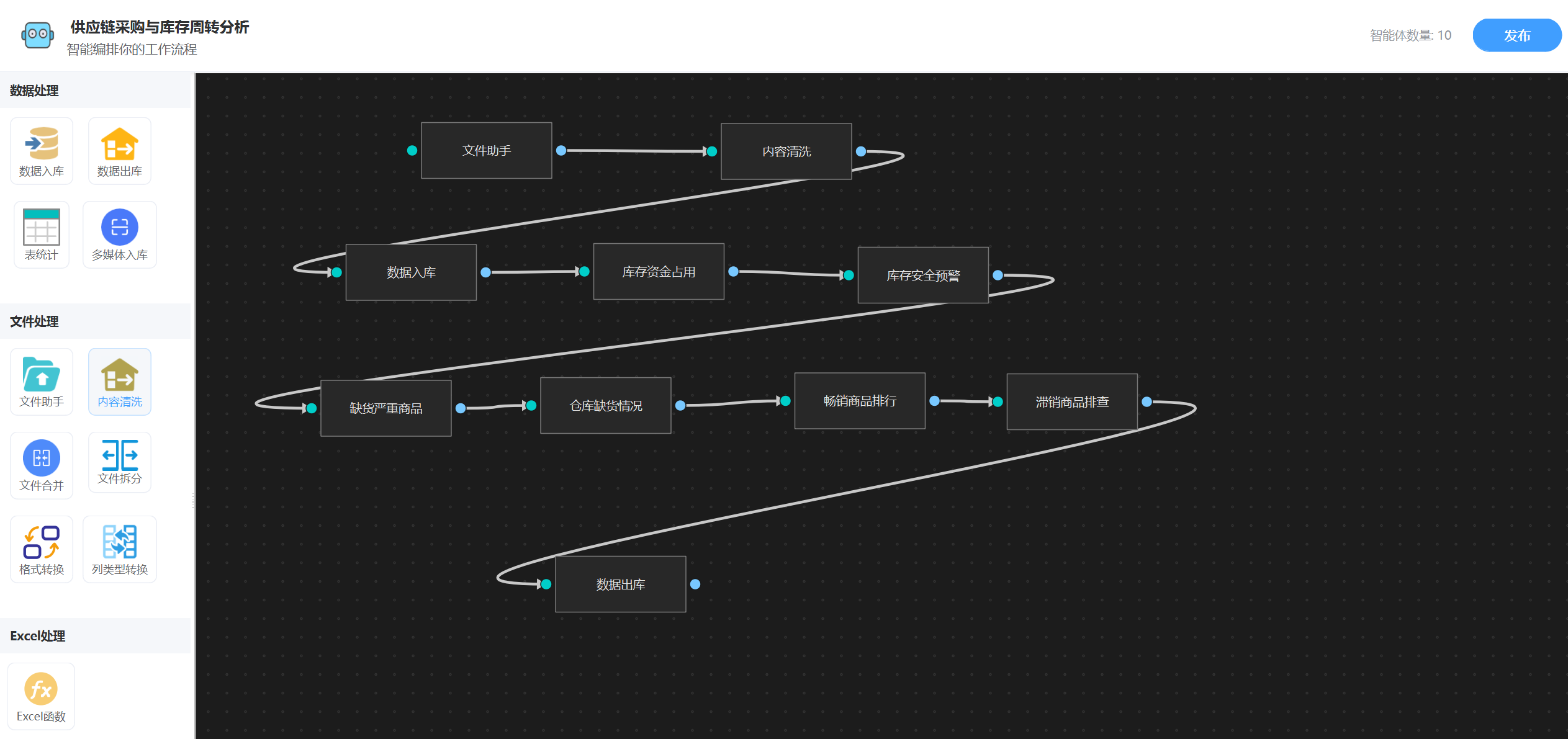

下图为一个复杂任务工作流,左侧是智能体,右侧是智能体编排的任务,图示例:

一、数据清洗

原始数据通常不是直接可用的,数据分析里一个很重要的环节就是数据清洗。DT-Bot通过简单的提示词描述,比如下面口吻:

1. 删除“订单ID”列为空的记录。

2. 删除“账期结束”列早于“账期开始”的记录。

3. 将“客户编码”列中的前后空格清理掉,把小写字母统一转成大写。并且将“#”,“_”,“/”,“.”, 空格" ,这些字符都替换成"-"。

4. 删除“订单号”列重复的记录,仅保留第一次出现的记录。

5. 新增“订单摘要”列,将“下单渠道”“客户等级”“收货省份”三列的值按“渠道-等级-省份”的形式拼接起来。

6. 将“支付金额”列统一保留2位小数,按四舍五入修改原值。通过AI的基础,对清洗步骤进行链式描述,就可以达到对原始XLSX,CSV表格的数据清洗操作。

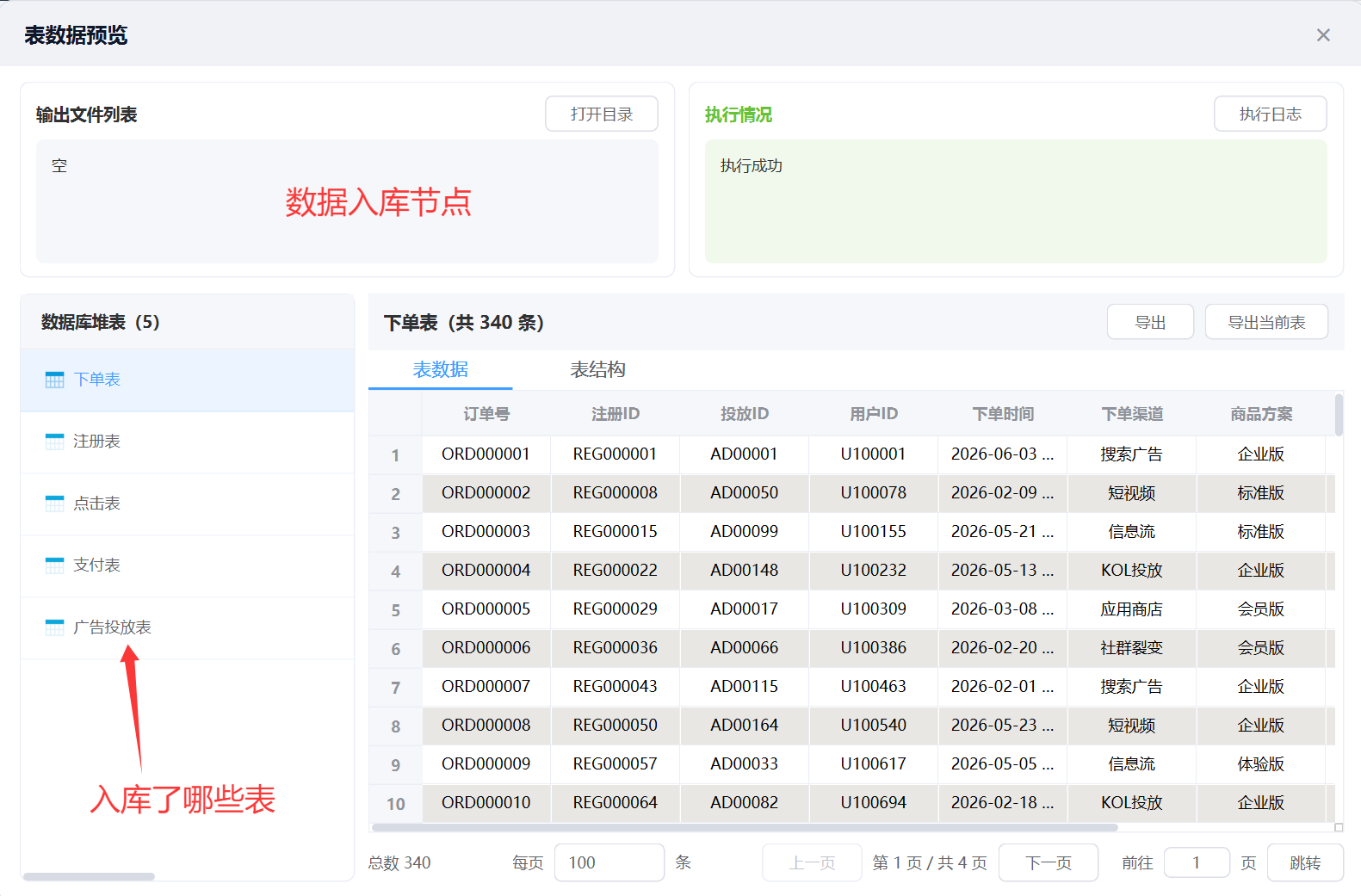

二、数据入库

表格数据需要先入库,然后后面才可以进行表统计。

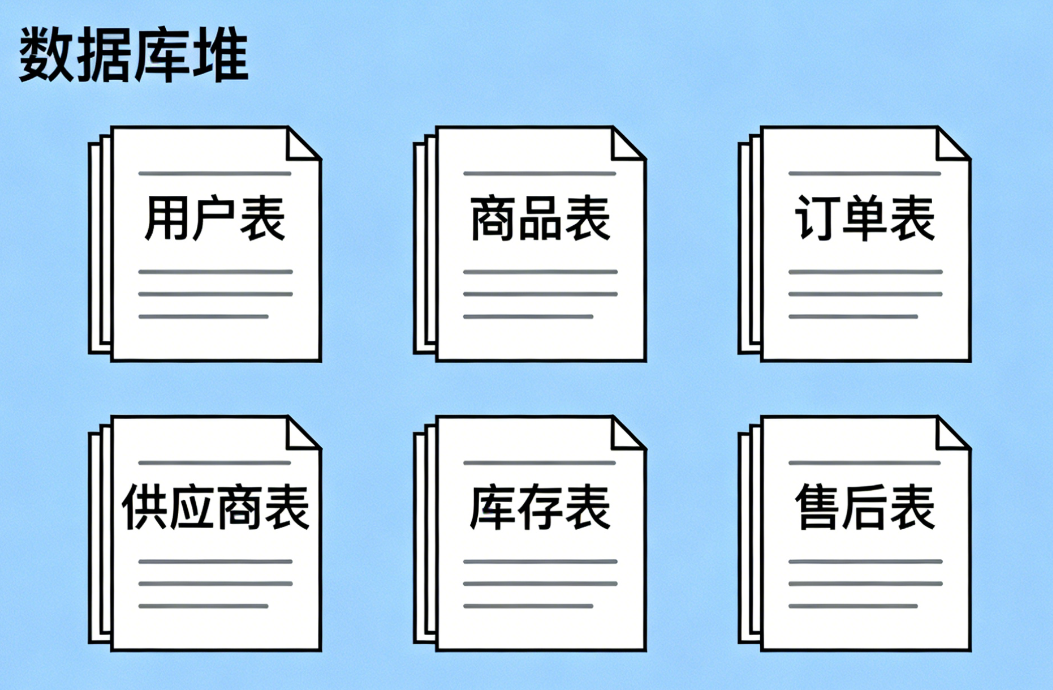

DT-Bot 运行时,会首先创建一个独立的数据库堆,然后将各种数据文件变成一张张的表,放到数据库堆里面,这就是入库操作。

表:就是一个二维结构的数据,例如excel,csv的行列数据,表有表名称,数据库堆中的表名称是唯一的,后续的描述操作都要指定到表名称。

数据库堆:多张表组成一个数据库堆,表数量没有限制,大小也没有限制,但不能超过磁盘剩余空间。

通过入库,我们就构建好了数据库堆,如下结构图:

三、表统计

DT-Bot 的表统计非常强大,充分利用AI加成,内部构建了一套完整的数据统计学,您只需要模糊的描述,如下口吻:

1. 帮我找出退款金额最高的前 10 笔退款记录,看看都是什么订单、什么商品、什么退款原因。

2. 查看每个店铺的总销售额与最终利润。

3. 帮我看看最近一周来了多少人访问,有多少人最后注册成用户了,注册转化怎么样。

4. 帮我算一下每个活动的 ROI,看看投一块钱大概能换回来多少收益。

5. 我想知道哪些活动虽然卖得多,但是优惠券和活动折扣给得太狠,最后利润并不高。

6. 统计低于安全库存的商品,查看需要优先补货的商品清单。

7. 把 Boss直聘、智联、猎聘、内推这些渠道从投递到面试、再到 offer、最后到接受这一整条链路拉出来,看哪个渠道最值钱。

8. 把工时特别短、特别长的人挑出来,看是不是考勤异常、请假太多,还是加班过头了。当然,如果您是数据统计行业精通者,懂SQL的话,还可以这样专业的描述:

1. 请基于‘订单明细’表,筛选出下单日期在2024年且订单金额>100的记录,然后按‘城市’汇总,输出每个城市的订单数、总金额、平均金额,并按总金额从高到低排序。

2. 基于“缺货严重商品”、“库存表”、“销售表”、“入库表”、“退货表”、“采购单表”、“库存安全预警”、“库存资金占用”进行统计;

分组维度:仓库ID;输出字段:仓库ID、入库数量、缺货天数;

统计指标:入库数量、缺货天数;

排序规则:按入库数量从高到低排序;

补充约束:使用‘缺货严重商品’表、按‘仓库’分组、找出‘缺货压力最大的仓库’。

关联路径:缺货严重商品通过商品ID关联库存表;缺货严重商品通过商品ID关联销售表;缺货严重商品通过商品ID关联入库表;缺货严重商品通过商品ID关联退货表。通过口语化的描述,就可以生成结果统计表,然后会自动入库到数据库堆,供后续使用和下载。

四、数据出库

支持将数据库中的任意多张表一键出库,并下载为 CSV、XLSX 等常见格式文件。出库完成后,还可通过智能体编排进一步对数据进行处理,如格式转换、Excel 公式应用、表格美化等,满足多样化数据输出需求。如有新的业务场景或定制化功能需求,可联系我们免费开发专属智能体。

五、智能体执行监控,结果可追溯

DT-Bot 配置的工作流的每一个智能体的执行都是由严格的监控的,你可以监控每一个智能体节点的运行结果。还可以对数据库堆的所有表,以及数据进行查看。

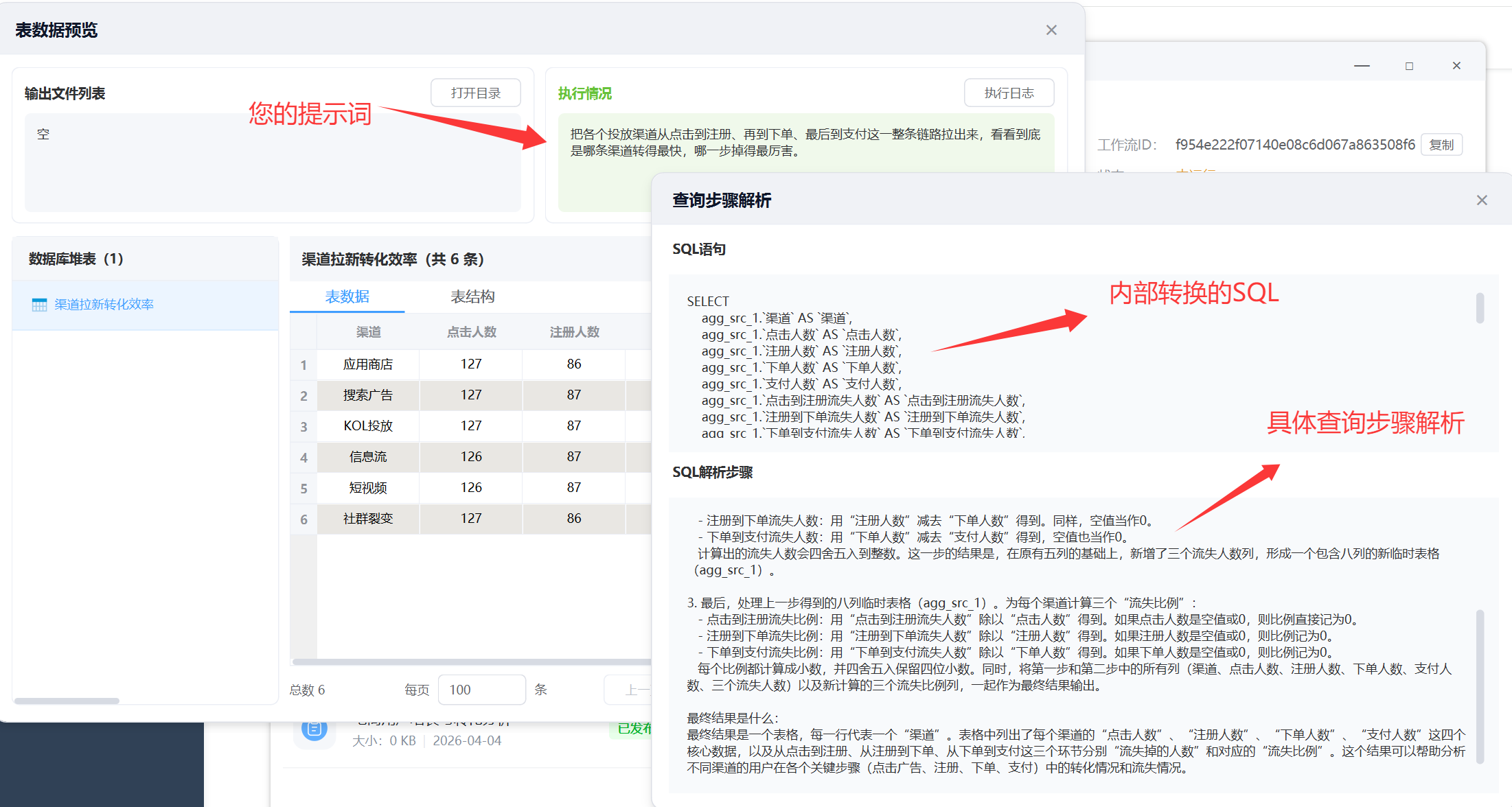

对于表统计,我们还可以回溯您的提示词,经过AI分析的具体步骤,如下案例:

对于单个节点可以查看运行结果,如图:

六、支持节点调试

DT-Bot支持节点调试功能,您可以在任何一个节点进行运行,而不必每次都整个工作流执行,在节点右键即可执行调试。如图:

系统会将当前节点和箭头连接的上游所有节点进行执行。

七、支撑千万数据量级以上

DT-Bot 在设计上充分考虑了海量数据处理场景,单表支持千万级以上的数据量。所有数据均存储于本地磁盘(位于软件目录下),处理时采用分页加载机制,仅将当前所需数据调入内存,从根本上避免内存溢出问题。

经实测,约 1000 万行、10 列左右的 CSV 数据,占用磁盘空间约为 1.5 GB。如需处理大规模数据,请提前预留充足的磁盘空间。

八、数据安全性

DT-Bot 在数据处理过程中高度保障数据安全。所有表格数据均存储在本地磁盘(软件安装目录下),不经过任何云端服务器。这一设计不仅确保了数据的物理隔离与控制权,也使得 DT-Bot 能够兼容千万级以上的海量数据场景。

在调用 AI 能力时,流向大模型的仅为用户所描述的提示词指令,原始表格数据不会上传。但需特别说明的是:部分文本提取类智能体(如“多媒体入库智能体”)会将图片中的文字内容通过 OCR 识别后,发送至 AI 模型进行关键信息提取。

所有 AI 接口均采用直连官方 API 的方式,不经过任何第三方中转服务器,进一步保障数据传输链路的安全性。使用时,用户需自行准备并配置官方 API 密钥(API Key)。

九、支持的AI模型

DT-Bot 目前已集成主流的四大 AI 模型:DeepSeek、通义千问、智谱与Kimi,全面覆盖各类自然语言处理与数据交互需求。如需要使用其他模型,可联系我们免费扩展支持。

所有模型密钥(API Key)均存储在用户本地,不经过任何远程服务器,充分保障密钥安全与数据隐私,请放心使用。

十、Token的用量

DT-Bot 在设计理念上与市面上常见的“小龙虾”式工具不同,通过用户自定义流程配置,显著降低了对大模型 token 的消耗。所有数据处理逻辑均由用户明确设定,既减少了因自动推理带来的不确定性,也大幅提升了执行准确性。

实际使用中,token 用量极低。以 DeepSeek 为例,充值 10 元后,在持续数月的高频测试与压力场景下,至今仍未用完,充分体现了 DT-Bot 在 token 成本控制上的优异表现。

十一、总结

DT-Bot 让不懂技术的人,也能轻松、安全、低成本地处理海量数据。用户只需用自然语言描述需求,通过拖拽搭建可视化工作流,即可完成从数据入库、智能处理到结果出库的全流程操作。所有数据存储在本地,支持千万级数据量,AI仅传输提示词,token消耗极低,既保障隐私又大幅降低成本。